IA : Google défie Nvidia avec ses propres puces

Google lance de nouvelles puces IA pour l'inférence et concurrence Nvidia. Comment cela impacte-t-il l'investissement automatisé et l'épargne intelligente ?

La course aux puces IA : un nouveau chapitre s'ouvre

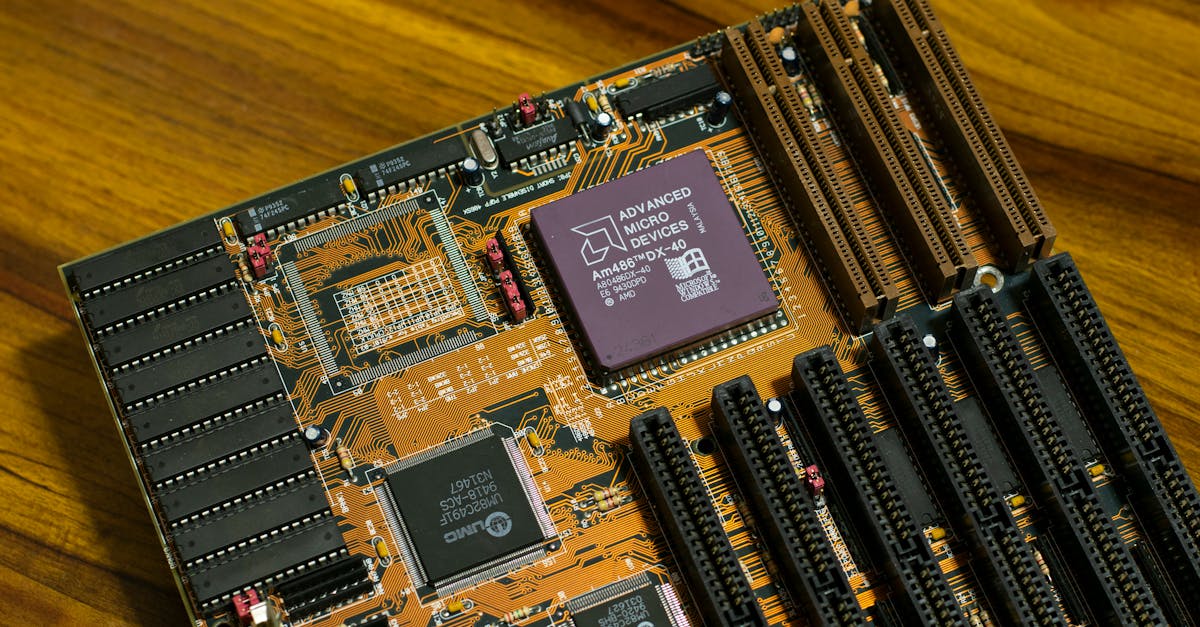

Dans le monde effervescent de l'intelligence artificielle, une bataille technologique de haute volée se joue actuellement. Google, le géant de Mountain View, vient de frapper un grand coup en annonçant une offensive sur le marché des puces dédiées à l'IA. Ces processeurs, conçus sur mesure par Google, sont devenus en quelques mois seulement l'une des ressources les plus convoitées du secteur. Des développeurs d'IA de premier plan, y compris certains des concurrents les plus directs de Google, se les arrachent déjà. L'objectif de l'entreprise détenue par Alphabet Inc. est clair : capitaliser sur cet élan en introduisant de nouvelles puces spécifiquement conçues pour l'inférence, c'est-à-dire l'exécution des modèles d'IA une fois qu'ils ont été entraînés. Cette stratégie positionne Google comme un concurrent sérieux face à Nvidia Corp., le leader incontesté du marché, dans un secteur en pleine expansion. L'enjeu est colossal : maîtriser le matériel qui alimente la révolution IA, c'est détenir une clé essentielle de son avenir. Pour les acteurs de la finance, et particulièrement ceux qui s'intéressent à l'épargne intelligente et à l'investissement automatisé, cette dynamique est loin d'être anecdotique. Comprendre qui contrôle les outils fondamentaux de l'IA, c'est anticiper les évolutions futures des marchés et des technologies qui les façonnent. La demande croissante pour ces puces souligne la maturité rapide de l'écosystème IA et la nécessité pour les entreprises de disposer de capacités de calcul toujours plus performantes et efficientes. Google, en investissant massivement dans ses propres solutions matérielles, montre sa détermination à ne pas laisser le champ libre à ses rivaux et à s'assurer une place de choix dans cette course de fond.

👉 À lire : Amazon : IA et fixation des prix, un enjeu pour vos placements

L'importance cruciale de l'inférence dans l'IA

Comprendre la stratégie de Google nécessite de saisir la distinction fondamentale entre l'entraînement et l'inférence des modèles d'IA. L'entraînement est le processus initial, souvent très gourmand en ressources de calcul, où un modèle apprend à partir d'énormes quantités de données. C'est un peu comme la période d'étude intensive d'un étudiant. Une fois cet entraînement terminé, le modèle est prêt à être utilisé, c'est-à-dire à faire des prédictions ou à générer des résultats en réponse à de nouvelles entrées. C'est l'étape de l'inférence. Si l'entraînement demande une puissance brute considérable, l'inférence, elle, requiert efficacité, rapidité et optimisation des coûts, surtout lorsqu'elle doit être réalisée à grande échelle, 24h/24 et 7j/7. Les puces dédiées à l'inférence doivent être capables de traiter les requêtes rapidement tout en consommant le moins d'énergie possible. C'est là que réside le génie de la spécialisation matérielle. Google, avec ses puces TPU (Tensor Processing Units) de nouvelle génération, vise précisément à exceller dans ce domaine. Ces puces sont conçues pour accélérer spécifiquement les calculs nécessaires à l'exécution des modèles d'IA, offrant ainsi des performances supérieures et une meilleure efficacité énergétique par rapport aux processeurs généralistes. Pour un service d'épargne intelligente qui doit analyser en temps réel des flux de données financiers complexes et prendre des décisions d'investissement automatisées, la rapidité et l'efficacité de l'inférence sont primordiales. Une latence réduite et des coûts de calcul maîtrisés permettent d'offrir des services plus réactifs et plus rentables.

👉 À lire : IA : Le boom du cuivre, une course folle pour l'Amérique

Google vs. Nvidia : le duel des titans du silicium

Le marché des puces pour l'IA est actuellement dominé par Nvidia, dont les GPU (Graphics Processing Units) sont devenus la référence pour l'entraînement des modèles les plus complexes. Cependant, Google a depuis longtemps investi dans ses propres solutions matérielles, les fameuses TPU. Ces puces, développées en interne, ont permis à Google de maîtriser ses coûts d'infrastructure pour ses propres services d'IA (Recherche, Assistant, Traduction, etc.) et de proposer une alternative de plus en plus performante. L'annonce de nouvelles puces dédiées à l'inférence par Google n'est donc pas une surprise totale, mais elle marque une offensive plus directe sur le marché. En proposant ces puces à d'autres entreprises, y compris des rivaux, Google cherche à créer un nouvel écosystème matériel et logiciel autour de ses technologies. Nvidia n'est pas inactive et continue d'innover avec ses propres GPU et plateformes logicielles (CUDA). La concurrence entre ces deux géants stimule l'innovation à un rythme effréné. Pour les entreprises qui développent des solutions d'IA, y compris celles qui visent à optimiser la gestion de l'épargne et les stratégies d'investissement, cette compétition est une excellente nouvelle. Elle se traduit par :

- Une baisse potentielle des coûts grâce à l'augmentation de l'offre et à l'innovation.

- Des performances accrues, permettant des analyses plus fines et des décisions plus rapides.

- Une diversification des fournisseurs, réduisant la dépendance à un seul acteur.

Cette rivalité technologique, bien que centrée sur le matériel, a des implications directes sur la manière dont l'IA sera déployée dans tous les secteurs, y compris celui de la finance personnelle. L'efficacité des puces d'inférence peut directement impacter la réactivité et la rentabilité des agents intelligents dédiés à la gestion d'actifs.

Vous voulez l'appliquer à votre situation ? Un conseiller Epargne IA vous rappelle gratuitement sous 24 h pour un audit personnalisé.

Réserver mon audit gratuit →L'impact sur l'investissement automatisé et l'épargne intelligente

La course à la puissance de calcul pour l'IA, incarnée par le duel Google-Nvidia, a des répercussions directes et significatives sur le domaine de l'épargne intelligente et de l'investissement automatisé. Les agents IA, tels que ceux qui promettent d'optimiser votre épargne et vos placements 24h/24, dépendent intrinsèquement de la performance et de l'efficacité des infrastructures matérielles sous-jacentes. Des puces plus rapides et plus économes en énergie, particulièrement celles optimisées pour l'inférence, permettent à ces agents de :

- Analyser en temps réel des volumes massifs de données financières : cours boursiers, actualités économiques, indicateurs macroéconomiques, rapports d'analystes, etc.

- Exécuter des stratégies d'investissement complexes avec une latence minimale, réagissant ainsi plus promptement aux fluctuations du marché.

- Affiner les algorithmes de prédiction et de gestion des risques grâce à une capacité de traitement accrue.

- Réduire les coûts opérationnels, ce qui peut se traduire par des frais de gestion plus bas pour les utilisateurs finaux.

Imaginez un agent IA capable d'évaluer instantanément l'impact d'une annonce économique majeure sur des dizaines de classes d'actifs, puis d'ajuster votre portefeuille en conséquence, le tout en quelques millisecondes. C'est la promesse d'une IA performante, rendue possible par des avancées matérielles comme celles initiées par Google. Pour les investisseurs particuliers, cela signifie l'accès à des outils de gestion financière de plus en plus sophistiqués, capables d'offrir une gestion proactive et personnalisée de leur patrimoine. L'optimisation de l'épargne devient ainsi plus accessible, plus dynamique et potentiellement plus rentable. La capacité de Google à proposer des solutions matérielles dédiées à l'inférence pourrait accélérer le déploiement de ces technologies avancées, démocratisant l'accès à une gestion financière assistée par IA de pointe.

La stratégie de Google : un pari sur le long terme

Le développement et la commercialisation de puces IA par Google ne sont pas une simple réaction à la domination de Nvidia. Il s'agit d'une stratégie fondamentale et de long terme visant à maîtriser l'ensemble de la chaîne de valeur de l'IA, du matériel au logiciel, en passant par les modèles eux-mêmes. En concevant ses propres puces, Google s'assure que ses besoins spécifiques en matière d'IA sont parfaitement satisfaits. Les TPU sont optimisés pour les tâches d'apprentissage automatique et d'inférence, offrant ainsi des avantages significatifs en termes de performance et d'efficacité par rapport aux solutions plus généralistes. De plus, en ouvrant la possibilité à d'autres entreprises d'utiliser ces puces, Google cherche à établir un standard de facto, similaire à ce que Nvidia a réussi avec CUDA. Cela pourrait créer un écosystème où les développeurs d'IA privilégieraient les outils et les plateformes de Google. Le succès de cette stratégie dépendra de plusieurs facteurs : la capacité de Google à surpasser Nvidia en termes de performance et de flexibilité, la qualité de son offre logicielle et de ses outils de développement, ainsi que sa capacité à convaincre les acteurs du marché de la valeur ajoutée de ses solutions. Pour les entreprises qui développent des agents d'épargne et d'investissement automatisé, l'émergence d'une plateforme matérielle concurrente solide pourrait signifier plus de choix, des coûts réduits et des innovations plus rapides. La vision de Google est claire : l'IA est le futur, et le matériel en est le fondement. En contrôlant ce fondement, Google se positionne idéalement pour façonner ce futur.

Les défis et opportunités pour les développeurs d'IA

L'offensive de Google sur le marché des puces IA représente à la fois un défi et une opportunité majeure pour les développeurs et les entreprises du secteur. Pour les concurrents directs de Google, comme les géants du cloud qui développent leurs propres accélérateurs IA, la pression s'intensifie. Ils doivent non seulement rivaliser avec les innovations de Nvidia, mais aussi désormais prendre en compte l'offre de Google. Cependant, pour de nombreuses autres entreprises, en particulier celles qui sont plus petites ou qui n'ont pas les ressources pour développer leur propre matériel, l'arrivée de Google comme fournisseur de puces est une excellente nouvelle. Cela signifie :

- Plus d'options matérielles : les développeurs peuvent choisir la solution la plus adaptée à leurs besoins spécifiques en termes de performance, de coût et de consommation d'énergie.

- Potentiel de réduction des coûts : la concurrence accrue entre les fournisseurs de puces tend à faire baisser les prix, rendant l'IA plus accessible.

- Accélération de l'innovation : la disponibilité de matériel plus performant permet de repousser les limites de ce qui est possible avec l'IA, ouvrant la voie à de nouvelles applications et à des améliorations significatives des services existants.

Pour les entreprises spécialisées dans l'épargne intelligente et l'investissement automatisé, ces avancées sont particulièrement prometteuses. L'accès à des puces d'inférence optimisées peut permettre de construire des agents IA plus réactifs, capables de prendre des décisions éclairées en temps réel, et ce, à moindre coût. "Chaque amélioration dans l'efficacité du calcul se traduit directement par une meilleure expérience utilisateur et une rentabilité accrue pour nos services basés sur l'IA", confie fictivement un responsable R&D d'une fintech innovante. L'enjeu est donc de savoir comment exploiter au mieux ces nouvelles capacités pour créer des solutions d'épargne et d'investissement toujours plus performantes et accessibles.

Vous voulez l'appliquer à votre situation ? Un conseiller Epargne IA vous rappelle gratuitement sous 24 h pour un audit personnalisé.

Réserver mon audit gratuit →L'avenir de l'IA : un écosystème matériel diversifié

La bataille entre Google et Nvidia pour la domination du marché des puces IA n'est qu'un symptôme d'une tendance plus large : la démocratisation et la spécialisation du matériel IA. Il y a quelques années encore, Nvidia régnait en maître quasi absolu. Aujourd'hui, l'écosystème s'élargit, avec des acteurs comme Google, mais aussi AMD, Intel, et même des startups spécialisées qui développent des solutions matérielles innovantes. Cette diversification est une excellente nouvelle pour l'avenir de l'intelligence artificielle. Elle signifie que l'IA ne sera plus l'apanage de quelques géants technologiques disposant d'infrastructures massives, mais deviendra plus accessible à un plus grand nombre d'entreprises et de chercheurs. Pour le domaine de l'épargne intelligente et de l'investissement automatisé, cela ouvre des perspectives considérables. L'accès à du matériel spécialisé et abordable permettra de déployer des agents IA plus performants et plus sophistiqués, capables de gérer des portefeuilles diversifiés, d'anticiper les tendances du marché avec une précision accrue et d'offrir des conseils financiers personnalisés à grande échelle. L'objectif ultime est de rendre l'optimisation financière accessible à tous, quel que soit le montant de l'épargne. Les avancées dans le domaine des puces IA sont donc un moteur essentiel de cette révolution. Elles permettent de passer d'une IA théorique à une IA pratique, intégrée dans les outils du quotidien, y compris ceux qui nous aident à gérer notre argent. Comme le disait un analyste financier récemment : "L'IA n'est plus une question de 'si', mais de 'comment'. Et le 'comment' passe aujourd'hui par le silicium". L'évolution des puces de Google et la concurrence qu'elle impose à Nvidia dessinent les contours d'un avenir où l'IA sera omniprésente, performante et plus accessible que jamais.

Conclusion

La stratégie de Google, axée sur le développement de ses propres puces IA pour l'inférence, marque une étape significative dans la compétition technologique qui façonne l'avenir de l'intelligence artificielle. En défendant agressivement sa position face à Nvidia, Google ne fait pas que chercher à consolider son empire technologique ; il contribue à accélérer l'innovation matérielle, un pilier essentiel pour le déploiement à grande échelle des applications d'IA. Pour les amateurs d'épargne intelligente et d'investissement automatisé, cette dynamique est particulièrement porteuse d'espoir. Des puces plus performantes et plus efficientes signifient des agents IA capables d'analyser les marchés financiers avec une rapidité et une précision inégalées, d'exécuter des stratégies complexes en temps réel et, potentiellement, de réduire les coûts de gestion. L'objectif d'une optimisation de l'épargne et des placements 24h/24, rendu possible par des outils basés sur l'IA, devient ainsi plus tangible et plus accessible. La concurrence accrue dans le domaine du matériel IA promet un avenir où la technologie sera non seulement plus puissante, mais aussi plus démocratisée. Les entreprises comme Google, en repoussant les limites du possible, ouvrent la voie à des solutions financières plus intelligentes, plus réactives et plus personnalisées, démocratisant ainsi l'accès à une gestion de patrimoine optimisée. L'ère de l'épargne pilotée par l'IA ne fait que commencer, et les avancées dans le domaine des puces en sont le moteur principal.

Passez de la théorie à l'action.

Réservez un audit gratuit avec un conseiller Epargne IA. 30 minutes au téléphone, sous 24 h, sans engagement — pour transformer ces analyses en plan d'action concret pour votre patrimoine.

Réserver mon audit gratuit →